EU AI Act: mit kell tudnia egy magyar cégvezetőnek — 4 hónap van hátra

2026. augusztus 2-án élesedik az EU AI Act legfontosabb része: a magas kockázatú AI rendszerekre vonatkozó szabályok, a transzparencia-követelmények és a kötelező AI-leltár. A büntetési tétel? Akár 35 millió euró vagy a globális árbevétel 7 százaléka. Négy hónapod van. Megmutatom, mit kell csinálnod — és mit csináltunk mi a Glosternél.

Az elmúlt hetekben legalább hat magyar cégvezetőtől kaptam ugyanazt a kérdést: „Viktor, ez az EU AI Act szabályozás engem érint?” A rövid válasz: ha bármilyen AI-t használsz az üzletedben — CRM-ben scoring, HR-ben szűrés, ügyfélszolgálaton chatbot, marketingben képgenerálás — akkor igen, érint.

Az EU AI Act lényege 60 másodpercben

Az EU AI Act 2024. augusztus 1-én lépett hatályba, de a kötelezettségek fokozatosan élesednek. 2025 februárjában a tiltott AI-gyakorlatok és az AI-műveltségi kötelezettség már életbe lépett. 2025 augusztusától az általános célú AI-modellek (GPAI) szabályai érvényesek. A nagy mérföldkő 2026. augusztus 2. — ettől a naptól az Annex III szerinti magas kockázatú AI rendszerekre és a transzparencia-szabályokra vonatkozó teljes kötelezettségrendszer alkalmazandó.

Az Európai Bizottság 2025 novemberében javasolt egy „Digital Omnibus” csomagot, ami bizonyos magas kockázatú kötelezettségeket 2027 decemberéig tolna ki — de ez még nem elfogadott. Aki erre vár, az kockáztat. Az EU AI Act magyar cégekre is vonatkozik — mérettől függetlenül.

Az EU AI Act négy kockázati szintje — és te melyikbe esel

Az AI Act nem egyformán szabályoz mindent. Kockázat alapú megközelítést alkalmaz.

Elfogadhatatlan kockázat (tiltott): társadalmi pontozás (social scoring), tudatalatti manipuláció, bizonyos biometrikus felhasználások. Ezek 2025 februárja óta tilosak.

Magas kockázat (Annex III): AI a toborzásban, hitelbírálatban, oktatásban, bűnüldözésben, munkavállalók kezelésében. Ezekre jön a 2026. augusztusi határidő — kötelező dokumentáció, átláthatóság, emberi felügyelet, piaci nyomon követés.

Korlátozott kockázat: chatbotok, generatív AI, deepfake-ek, érzelem-felismerő rendszerek. Fő kötelezettség: a felhasználó tudja, hogy AI-val kommunikál. A generatív AI tartalom legyen jelölve. Ez szintén 2026. augusztus 2-től alkalmazandó.

Minimális kockázat: spam szűrők, ajánlórendszerek, készletkezelő AI. Nincs külön kötelezettség az AI Act alatt, de a GDPR és fogyasztóvédelem továbbra is érvényes.

A legtöbb magyar KKV és középvállalat a „korlátozott” és „magas” kockázat határán mozog. Ha HR-ben használsz AI-alapú szűrést vagy az ügyfélszolgálatodon chatbot fut — az nem minimális kockázat.

Te „deployer” vagy — és ez fontos

Az AI Act megkülönbözteti a fejlesztőt (provider) és a felhasználót (deployer). A magyar vállalatok döntő többsége deployer: nem fejlesztik az AI modellt, hanem SaaS-ként vagy API-ként használják mások termékét.

De a deployer-nek is vannak kötelezettségei magas kockázatú rendszereknél: emberi felügyeletet kell biztosítani, az érintetteket tájékoztatni kell, és alapjogi hatásvizsgálatot (FRIA) kell végezni bizonyos esetekben. Ha pedig lényegesen módosítod az AI rendszert — mondjuk saját adatokkal finomhangolod vagy más célra használod — provider-ré válsz, és az összes fejlesztői kötelezettség rád hárul.

A Center for Data Innovation 2025 végi felmérése szerint az európai KKV-k kevesebb mint 30 százaléka kezdte el az AI Act-ra való felkészülést. Stratégiai hiba.

A büntetési tételek — nem vicc

A számok egyértelműek:

- 35 millió euró vagy a globális árbevétel 7% — tiltott AI-gyakorlatok megsértéséért

- 15 millió euró vagy 3% — magas kockázatú rendszerek kötelezettségeinek megsértéséért

- 7,5 millió euró vagy 1,5% — helytelen adatszolgáltatásért a hatóságoknak

KKV-k és startupok esetében a büntetések arányosak — az árbevétel-alapú plafonok érvényesek, nem a fix összegek. De „arányos” nem jelent „elhanyagolhatót”.

Mit kell csinálnod — 5 konkrét lépés

1. AI-leltár készítése. Írd össze minden AI rendszert, amit a céged használ. SaaS, API, beépített funkció — minden. A legtöbb vállalat nem is tudja, hány helyen fut AI a folyamataiban. A ChatGPT előfizetéstől a CRM lead scoring-on át a chatbotig — minden bele tartozik.

2. Kockázati besorolás. Minden azonosított rendszert sorolj be a négy szint egyikébe. Ha bizonytalan vagy: a toborzásban, munkavállalói értékelésben, hitelbírálatban és alapvető szolgáltatásokhoz való hozzáférésben használt AI jellemzően magas kockázatú.

3. Szállítói kérdőív. Minden AI szállítódnak tedd fel: van-e Annex IV szerinti technikai dokumentációjuk? Milyen adatokkal tanították a modellt? Milyen emberi felügyeleti mechanizmust biztosítanak? Regisztrálták-e a rendszert az EU adatbázisban? Aki ezekre nem tud válaszolni, az compliance-kockázat.

4. Transzparencia-szabályok betartása. Ha chatbotot üzemeltetsz: a felhasználó tudja, hogy AI-val beszél. Ha generatív AI-val készül tartalom: legyen jelölve. Ez 2026 augusztusától minden kockázati szinten kötelező.

5. Felelős kijelölése. Legyen egy ember a szervezetben, aki az AI compliance-ért felel. Nem kell külön jogi osztály — de kell valaki, aki az AI-leltárt karbantartja, a besorolásokat felülvizsgálja és a szállítókat számon kéri.

Amit mi csináltunk a Glosternél

A Gloster 340 fős, tőzsdén jegyzett IT szolgáltató cég — tehát mi egyszerre vagyunk AI deployerek (a saját működésünkben) és AI tanácsadók (az ügyfeleink számára). A kettős szerep miatt hamarabb kellett lépnünk.

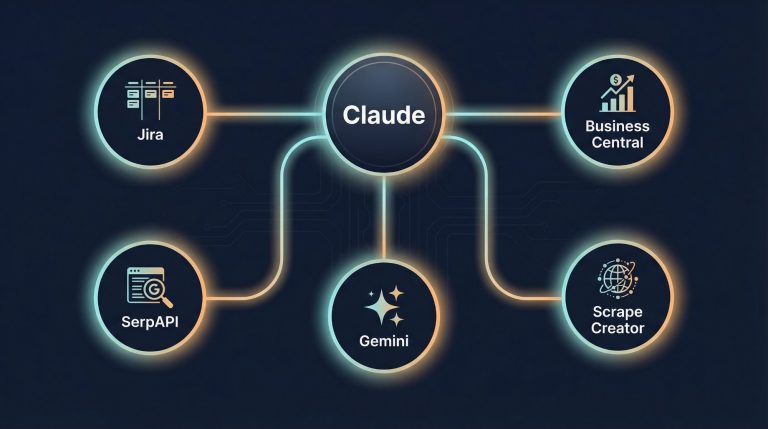

Az AI governance nálunk nem egy dokumentum — hanem működő gyakorlat. 23 AI skill fut a napi operációban, mindegyikhez definiáltunk hatásköröket, jóváhagyási lépéseket és audit trail-t. Amikor az AI agent küld emailt a nevemben: nem megy ki jóváhagyás nélkül. Amikor az ERP-ből kérdez le adatot: least-privilege jogosultságokkal rendelkezik. Amikor a Jira-t auditálja: naplózza, mit nézett meg.

Ez pontosan az a szemlélet, amit az AI Act megkövetel — csak mi nem azért csináljuk, mert kötelező, hanem mert józan ész.

Összefoglalás

Az EU AI Act nem opcionális. Nem csak a tech óriásokra vonatkozik. Nem fog eltűnni. Négy hónap múlva élesednek a legfontosabb kötelezettségek — és az európai KKV-k 70 százaléka még semmit nem csinált.

A felkészülés nem bonyolult: AI-leltár, kockázati besorolás, szállítói kérdőív, transzparencia, felelős kijelölése. Öt lépés. A legtöbb egy hét alatt elvégezhető.

A kérdés nem az, hogy meg kell-e csinálnod. A kérdés az, hogy mikor kezded el. A válasz: ma.

Gyakran ismételt kérdések (GYIK)

Mikor lép hatályba az EU AI Act Magyarországon?

Az EU AI Act fokozatosan élesedik: 2025 februártól a tiltott AI gyakorlatok, 2025 augusztustól az általános célú modellek, és 2026. augusztus 2-tól a magas kockázatú AI rendszerek szabályai. Magyarországon az NMHH végzi a felügyeletet.

Kell-e AI audit a magyar KKV-knak az EU AI Act miatt?

Igen — minden cégnek, amely mesterséges intelligenciát használ, össze kell írnia az AI eszközöket és kockázati szint szerint besorolnia. Ez az AI compliance első lépése és egy hét alatt elvégezhető.

Hogyan kezdjem el az AI Act felkészülést cégvezetőként?

Öt lépésben: AI leltár készítése, kockázati besorolás, szállítói kérdőív, transzparencia-szabályok betartása, felelős kijelölése. A Gloster 340 fős cégcsoportnál ugyanezt alkalmaztuk.

Az EU AI Act a ChatGPT és Copilot használatára is vonatkozik?

Igen. Minden generatív AI eszközre vonatkozik a transzparencia-kötelezettség 2026 augusztusától: az AI által generált tartalom legyen jelölve.

Kapcsolódó cikkek

- Már nem chatbotokat építünk — hanem digitális munkaerőt — A Gloster AI governance gyakorlata: 23 skill, audit trail, least-privilege — az AI Act szellemében

- 7 egyedi AI connector, ami hetente 15-20 óra munkát takarít meg — Az AI-leltár első lépése: milyen AI rendszerek futnak a napi operációban